集微网消息,近日,第53届国际微架构大会(MICRO 2020)通过线上模式顺利召开。

图片来源:芯系清华

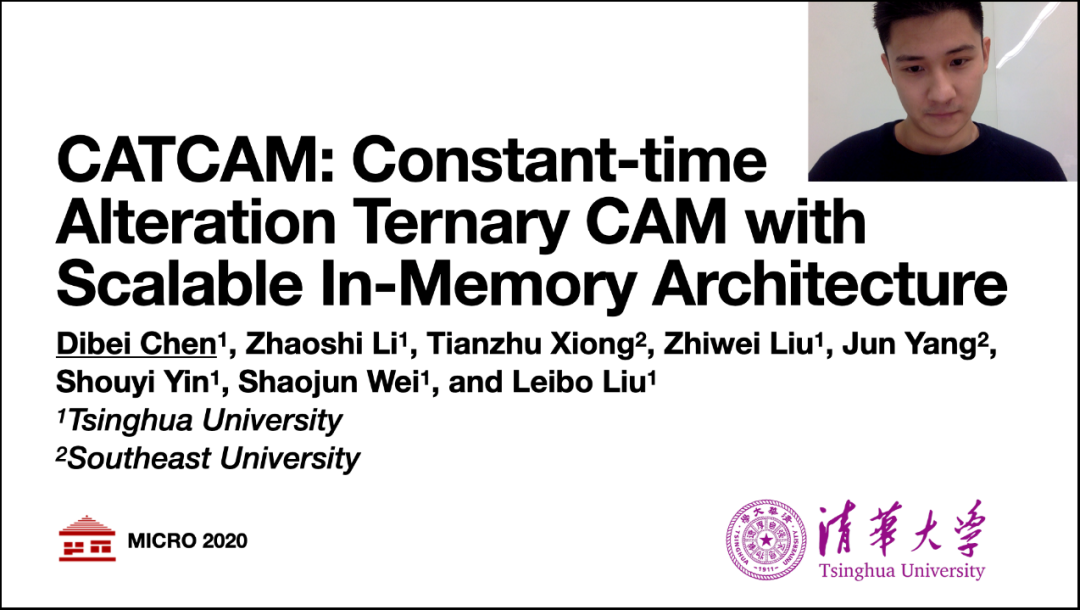

清华大学魏少军、刘雷波教授团队作了题为“CATCAM: Constant-time Alteration Ternary CAM with Scalable In-Memory Architecture”(一种基于可扩展存内架构并支持常数时间更新的三态内容寻址存储器)和题为“TFE: Energy-efficient Transferred Filter-based Engine to Compress and Accelerate Convolutional Neural Networks”(一种基于转换卷积核的卷积网络压缩与加速架构)的学术报告。

报告人分别是两篇论文一作陈迪贝和莫汇宇,论文通讯作者均是刘雷波教授。这是该团队斩获MICRO 2019最佳论文提名后,在体系结构顶级会议上的又一重要突破。

陈迪贝同学做了题为“CATCAM: Constant-time Alteration Ternary CAM with Scalable In-Memory Architecture”的报告,针对传统三态内容寻址存储器(TCAM)基于物理地址的规则优先级编码无法满足规则快速更新的问题,提出了基于矩阵的优先级编码方法,利用存内计算的范式实现了高效、可灵活扩展的硬件架构,设计了一种支持常数时间更新的三态内容寻址存储器(CATCAM)。通过重新设计三态内容寻址存储器的优先级机制,CATCAM消除了规则更新导致的大量规则迁移,在提升更新吞吐量和响应速度的同时保证了扩展性。与现有最优的TCAM更新算法相比,实现了至少三个数量级的性能提升。CATCAM是第一个能够同时满足常数时间匹配和更新的设计,有助于简化硬件交换机的设计。

莫汇宇同学做了题为“TFE: Energy-efficient Transferred Filter-based Engine to Compress and Accelerate Convolutional Neural Networks”的报告,针对现有利用神经网络的稀疏性进行非结构化压缩和加速,带来额外的编码存储和解码计算时延开销的问题,提出一种基于转换卷积核方法来极大减少转化卷积核模型中重复计算的数据处理方式、卷积映射方法及其硬件架构,不仅能保证模型的高压缩率,还能高效地加速网络模型运算。在同样工艺和频率下,该架构的面积为Eyeriss结构的57.96%,功耗为其24.12%。实验结果表明,与最优的神经网络架构在经典VGGNet网络上相比,该架构实现了最大4×的模型压缩,2.72×的加速及10.74×的能效提升。

近年来,清华大学魏少军教授、刘雷波教授团队在软件定义芯片方向取得了多项重要技术突破,关键技术在多项国家重大工程中得到批量应用,曾获国家技术发明二等奖、教育部技术发明一等奖、电子学会技术发明一等奖、中国发明专利金奖、世界互联网大会15项世界互联网领先科技成果等。(校对/图图)

登录

登录